客服 AI 的另一半:Fin Operator 是给运营团队的 Agent

Fin 公司(前 Intercom)于 2026-05-14 发布 Fin Operator,这是客服 SaaS 领域少见的「面向运营团队」的 AI Agent 品类:它不替代人工客服,而是用自然语言界面驱动 50+ 工具,帮助运营经理完成报表分析、知识库管理、对话调试、SOP 构建、QA 监控和事件检测六大任务。文章从品类发明逻辑、Pull Request 式提案 UI、单次对话跨技能闭环、主动感知事件检测四个维度拆解核心创新,末尾提炼四条可直接应用的设计洞察。

Research Brief

2026 年 5 月 12 日,Intercom 公司更名为 Fin1。两天后,更名后的第一个重磅产品来了。

"Fin is an agent for your customers. Fin Operator is an agent for your team."「Fin 是给你客户的 Agent,Operator 是给你团队的 Agent。」

这句话背后是一个被整个行业忽略了的问题:客服 AI 战场上,所有玩家都在争同一块地盘——替代人工客服回答终端用户的问题。Zendesk AI、Salesforce Agentforce、Ada、Decagon、Sierra,无一例外4。但「谁在管理这些 AI Agent 本身」——这个问题,没有人答过。

DCX Newsletter 的 Mark Levy 给出了一个更直白的战略判断4:旧品类叫「客服软件」,新战场是「谁拥有客服中的 AI Agent 层」。Fin Operator 是这场战争的第一枪。

创新①:「双角色对立」——一个品类发明,而不是一个功能更新

Fin Operator 通过自然语言界面驱动 50+ 工具,跨越报表分析、知识库管理、对话调试、SOP 构建、引导规则管理、QA 监控和突发事件检测七大领域5。它的目标用户是客服运营经理、知识经理、QA 主管——不是终端客户,也不是人工客服座席。

Fin VP of Product Brian Donohue 把这件事称为「与商业软件交互方式的范式转变」2。这话不像吹捧——这类产品以往被分散在数据分析师、知识经理、运营 BA 几个岗位上,没有任何一款产品把这七个场景整合进一个自然语言界面。

现有竞品里最接近的是 Level AI 的 AI Workers,但它聚焦 QA 和教练子场景,覆盖面远窄于 Operator6。

可借鉴洞察:在任何垂直赛道里,「面向使用者」和「面向管理者」往往是两个分开的产品机会。客服领域二十年来把所有 AI 能量都押在「帮助客户」上,「帮助管理客服系统的那个人」就成了品类空白。你的行业里,有没有类似的被忽略的管理者视角?

创新②:Pull Request 式提案系统——用开发者的工作习惯设计权力边界

Operator 的交互模型借用了软件工程里最成熟的人机协作机制:Pull Request。

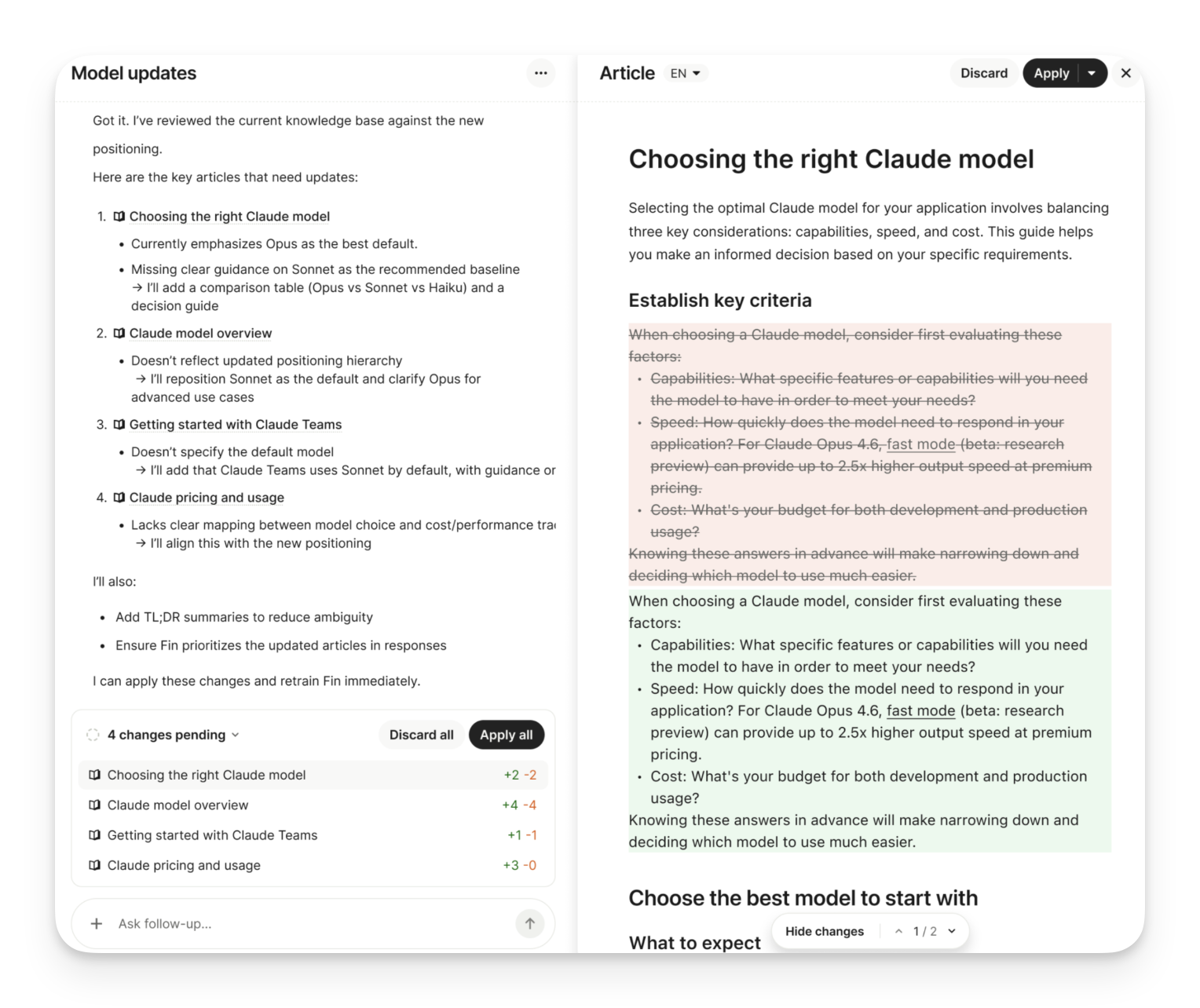

任何配置变更都走同一条路5:Operator 提出建议 → 以 diff 形式展示改动(绿色标注新增、红色标注删除)→ 运营人员审核 → 批准后才生效。Operator 没有任何直接发布、修改或删除内容的权限。

这个设计有一处值得细看:知识库管理场景里,Operator 不是用关键词搜索定位受影响的文章,而是用语义搜索扫描整个知识库,把间接引用了某条信息的文章也纳入修改范围7。例如,运营人员告知定价调整为 $15/月,Operator 会找出所有含「价格」「费用」「套餐」相关语义的文章,而不只是精确包含「$X」的那几篇。

对话调试场景更进一步7:运营人员分享一条回答出错的对话,Operator 读取完整转录记录,包括 Fin 的内部推理链和它当时调用的知识源——然后同时提出知识内容修改和 Procedure 条件修正两个提案。这意味着 Operator 能看到 AI 的「思考过程」,不只是表面的错误答案。

Fin 官方称,知识管理领域「Operator 每次使用都将数小时的工作压缩为分钟」2。

可借鉴洞察:AI Agent 拥有「提案权」而非「执行权」,这不是产品能力不足,而是信任建立的节奏设计。PR/diff 界面对于熟悉 GitHub 的用户来说几乎零学习成本,却把「AI 做了什么、改了什么」完整可见。设计高权限 AI 工具时,优先选用用户已经熟悉的审批隐喻,而不是新造一套审批界面。

创新③:单次对话完成「数据 → 诊断 → 提案」全链路

Fin 帮助中心描述了一个颇能说明问题的场景7:

运营人员让 Operator 分析最近 250 次对话,按「已解决 / 已升级 / 已放弃」分段,找出异常。Operator 发现账户访问类升级率 40%,显著高于整体均值;随后读取样本对话,定位根因——该类别缺少 SSO 设置相关内容;最后在同一个对话窗口里提出两个提案:一篇新知识文章草稿 + 一条引导规则。

帮助中心对此的定性是:「完整的数据到行动闭环——Operator 发现问题、诊断原因、提出修复——在单次对话中跨越四项技能」7。

这四项技能分别是:报表分析(发现升级率异常)、对话研读(定位根因)、知识创作(起草文章)、规则构建(起草 Guidance)。传统工作流里,这四步通常由三到四个人在三到四个工具里分别完成。

降低升级率的另一个场景7:Operator 主动识别出「可预测但缺少 SOP 的升级模式」,自动起草完整 Procedure——包含信息收集逻辑和路由条件——运营人员只需审核和调整阈值。

可借鉴洞察:把「数据查询」和「内容创作」放进同一个上下文窗口,让 AI 在分析完成后直接起草修复方案,是 B2B 工具里一种尚未被充分探索的交互模式。传统产品把「分析报表」和「编辑配置」分在两个完全不同的页面——AI 使得两者合并成一次对话成为可能。你的产品里,有哪两个本该连续的动作被不必要地拆开了?

创新④:主动感知异常的事件检测

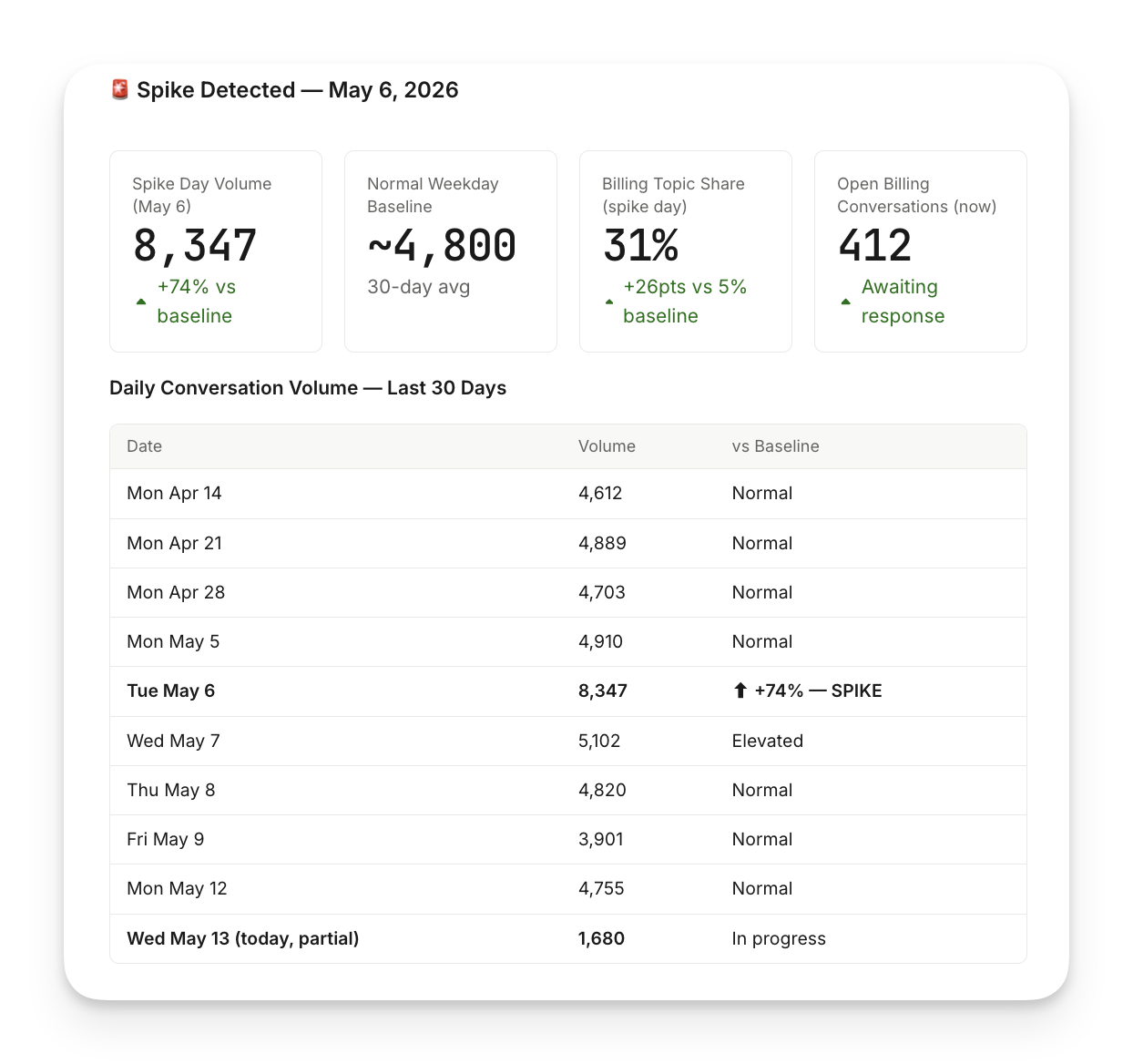

前三个场景都是运营人员主动发起任务。事件检测(Incident Detection)是反向的8:Operator 持续监控咨询量,检测到相对基线的统计偏差时主动发出警报。

以产品截图为例——2026 年 5 月 6 日,咨询量对比基线上涨 74%,当前积压 412 个与计费相关的未处理咨询8。Operator 追溯到 5 月 5 日涨价公告,自动将 412 条咨询分类为「涨价困惑、取消账户、降级套餐、退款」四类,并准备了一批情境化批量回复草稿,等待运营人员一键审批。

这个设计的要点不在于「自动分类」,而在于把「检测 → 归因 → 草拟回应」三步压进同一个事件流里,运营人员介入时看到的不是一个警报,而是一个已经完成了初步分析和处置预案的情况通报。

可借鉴洞察:AI 工具的「主动模式」通常比「被动查询」拥有更高的使用频率——因为用户不需要知道该问什么问题。事件检测在这里做的是「把警报变成简报」:同样的信息量,后者让用户可以直接决策,前者只是告知存在问题。你的产品有哪些通知可以升级成「附带初步分析和建议的简报」?

四条可带走的设计洞察

① 「面向管理者」是 B2B AI 里系统性被低估的品类切口。 所有人都在做「帮用户完成任务」的 AI,「帮管理者管理完成任务的系统」几乎还是空白。

② 用成熟隐喻设计 AI 审批界面。 PR/diff 界面对工程师几乎是本能反应;对运营人员,「修改前/修改后对比 + 一键批准」同样直觉。新建审批 UI 的成本远高于借用已有认知模型。

③ 同一上下文里完成分析和处置是 B2B AI 的关键体验差距。 当前 SaaS 产品普遍把「看数据」和「改配置」分在两个页面,AI Agent 使二者合并成一次对话窗口。这不是 UI 改版,是工作流的根本性重组。

④ 把「警报」升级为「情境简报」。 异常检测的终态不是发现异常,而是帮用户在收到警报的瞬间就具备决策所需的全部上下文。

Add more perspectives or context around this content.