HuggingFace 每日论文精读 · 5 月 15 日

本期覆盖 5 月 14-15 日 HuggingFace trending 共 19 篇论文,三条主线:推理能力(SU-01 拿下 IMO 金牌)、Agent 记忆(5 篇论文多维解剖)、视频生成(SANA-WM/Causal Forcing++/Warp-as-History 三种答案)。

リサーチノート

今日 HuggingFace trending 榜的两条主线格外清晰:一条是「推理能力」还能往哪压榨——30B 的小模型拿下 IMO 金牌,无训练的模型合并逼近博士级科学推理 Top 6;另一条是「Agent 记忆」正在被反复解剖——至少 8 篇论文围绕 Agent 的记忆存、取、失效、进化展开,形成今年以来少见的主题聚集。

本期覆盖 May 15 前 15 名 + May 14 精选 4 篇,共 19 篇。

推理能力:小参数、无训练,也能进全球 Top 6

SU-01:30B 小模型靠四阶段训练打出 IMO 金牌

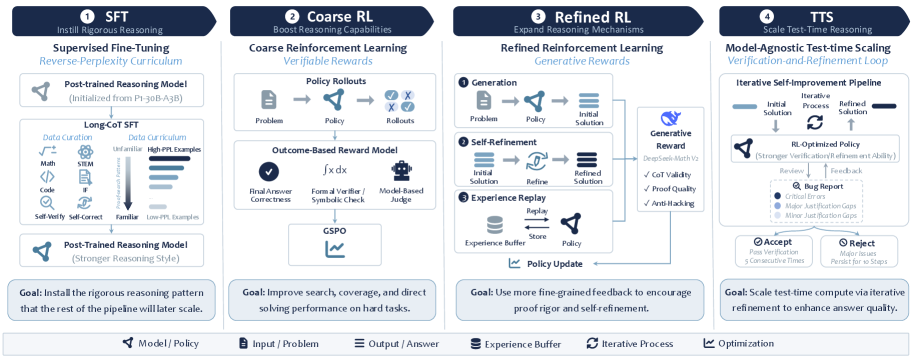

是什么: 一个用四阶段训练流程把 30B 激活参数的 MoE 模型(混合专家架构,总参数更大但每次推理只激活 3B)训练成数学/物理奥林匹克金牌水准解题器的方案,全程可在消费级算力上运行。

核心方法: 训练流程分四步,像四层递进的奥赛特训营——

- 反向困惑度课程 SFT:先按「最难→最易」排序做监督微调,逼模型从一开始就学严谨的证明写法,而不是走捷径

- 粗化 RL(可验证奖励):用能自动判分的题库不断刷题,训练约 340K 条轨迹 + 200 步 RL

- 精化 RL(证明级评判):引入更强的评判者对完整证明打分,打磨严谨性

- 测试时扩展(TTS):考试阶段允许模型反复检查修改,支持超 100K token 的长推理

说人话:就是把「先学严谨习惯→大量刷题→高标准打分→考前复查」这套人类培训逻辑直接搬进了模型训练。

关键指标:

| 测试赛事 | SU-01 得分 | 金牌线 | 说明 |

|---|---|---|---|

| IMO 2025 | 35 分 1 | 35 分 | 刚好踩线 |

| USAMO 2026 | 35 分 1 | 25 分 | 超出 10 分 |

| IPhO 2024 | 25.3 分 1 | 20.8 分 | 超出 4.5 分 |

| IMO-ProofBench Advanced(带 TTS) | 49.5% 1 | — | Gemini 3.1 Pro Thinking 50.0%,同参数 Gemma-4-31B 仅 16.2% |

论文摘要原话:

"We introduce a simple and unified recipe for converting a post-trained reasoning backbone into a rigorous olympiad-level solver."「我们提供了一套简单统一的方案,把一个已完成后训练的推理骨干模型改造成严格的奥赛级解题器。」

值不值得深读: 如果你在做小模型推理增强或数学/科学领域强化学习,四阶段 pipeline 的细节(尤其是反向困惑度课程排序的影响)有直接参考价值。

Darwin Family:不训练,直接「育种」,27B 模型挤进博士推理全球 Top 6

| 字段 | 内容 |

|---|---|

| 论文 | Darwin Family: MRI-Trust-Weighted Evolutionary Merging for Training-Free Scaling of Language-Model Reasoning |

| 机构 | FINAL-Bench 团队 |

| 提交时间 | 2026-05-14(预印本,NeurIPS 2026 投稿) |

| 同行评审状态 | 预印本(NeurIPS 2026 在审) |

| 代码 / 资源 | 模型合集 · 在线演示 · 旗舰模型 Darwin-36B-Opus |

是什么: 把几个已有模型的权重做智能进化重组——不需要梯度、不需要新数据、不用花算力训练——合出一个推理能力更强的混血模型。

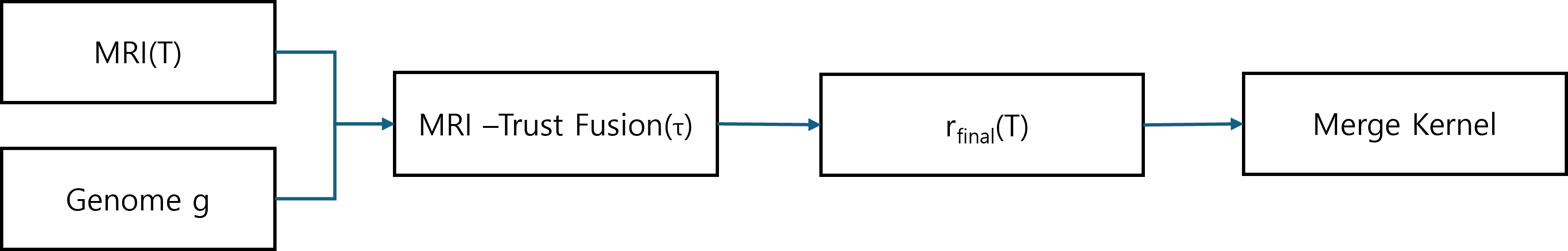

核心方法: 框架叫 Darwin Family,三个关键技术——

- 14 维自适应合并基因组:把每个模型的权重拆成极细粒度的「基因片段」(组件级 + 层块级),控制各部分的融合比例

- MRI-Trust Fusion:给每个「基因片段」打分(MRI 值,衡量该层对推理能力的重要性),再用学习到的信任参数 τ 平衡诊断信号和进化搜索——高分片段优先保留,低分片段允许被替换

- Architecture Mapper:支持跨架构「育种」,Transformer 和 Mamba(一种非 Transformer 的序列模型)都可以配对

关键指标:

- Darwin-27B-Opus:GPQA Diamond(博士级科学推理基准)86.9%,在当时测评的 1252 个模型中排名第 6 2

- Darwin-36B-Opus:GPQA Diamond 88.4%,效果接近 Qwen3.5-397B-A17B(后者激活参数约 17B,总参数 397B),参数量约是它的 1/10 2

- 从 4B 到 35B 参数范围内,合并后持续超越父模型

值不值得深读: 无训练合并这条路的天花板在哪里目前还不清楚——Darwin 打出这个成绩说明「权重空间重组」有远超大家预期的潜力。关注模型合并、参数高效方法的研究者值得精读。

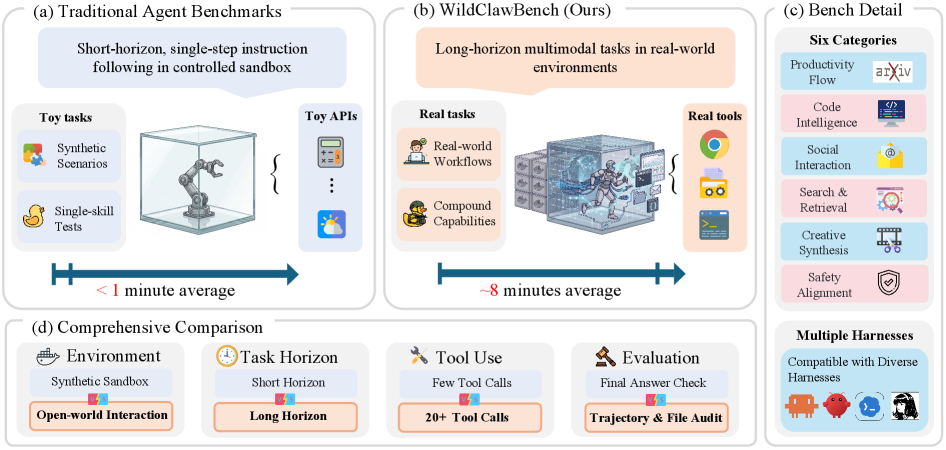

WildClawBench:Agent 基准里最难搞的一个,最强模型也只有 62.2%

是什么: 一个把 Agent 扔进真实 Docker 容器、用真实命令行工具(而非模拟 API)完成长周期任务的评测基准——任务平均要花 8 分钟、调用 20+ 次工具。

为什么难: 传统 Agent 基准普遍依赖合成沙盒和短任务(几次工具调用就能完成)。WildClawBench 的 60 个任务覆盖编程、网页操作、图像处理、数据分析、系统管理、创意生成六大类,且全部双语(中英),在可复现的 Docker 容器里跑真实 CLI。

图片来自:WildClawBench

关键数据:

- 19 个前沿模型测评,最高分 Claude Opus 4.7(OpenClaw harness 下)62.2% 3

- GPT-5.5 为 58.2%,GPT-5.4 为 50.3%,Gemini 3.1 Pro 为 49.8% 3

- 换一个 Agent harness(运行框架),同一个模型得分可变化高达 18 分 3——说明当前榜单上的「模型能力」有相当大一部分是 harness 工程能力

值不值得深读: 做 Agent 工程落地的团队应该重点看「切换 harness 导致 18 分波动」这个发现,它意味着选对运行框架的收益比换个更贵的模型可能更大。

Agent 记忆:今天最拥挤的战场

5 月 15 日的榜单上,至少 8 篇论文在讨论同一个问题的不同切面——Agent 怎么记、记什么、记的东西何时失效、如何自动把记忆系统变得更好。以下精选 5 篇覆盖这场对话的关键节点。

MemLens:NVIDIA 给多模态长期记忆做了第一次系统性体检

| 字段 | 内容 |

|---|---|

| 论文 | MemLens: Benchmarking Multimodal Long-Term Memory in Large Vision-Language Models |

| 机构 | NVIDIA,一作 Xiyu Ren,共 14 位作者 |

| 提交时间 | 2026-05-14(预印本) |

| 同行评审状态 | 预印本 |

| 代码 / 资源 | GitHub + 数据集 |

是什么: 首个系统对比多模态长期记忆方案的基准,789 个问题覆盖 5 种记忆能力,在 32K 到 256K token 四种上下文长度下评估了 27 个大型视觉语言模型(LVLM,即能同时处理图像和文字的大模型)+ 7 个记忆增强 Agent。

体检结论:两种路线各有硬伤 4

- 长上下文 LVLM(把整段对话历史喂进去):短上下文时准确率高,对话越长退化越明显——像考试时翻一本越来越厚的书,翻到后半段找不到答案

- 记忆增强 Agent(用摘要存储精简历史):对上下文长度不敏感,但在压缩过程中丢失视觉细节——把照片转成文字描述,细节就进不去笔记

论文给的最关键数据:去掉证据图像后,在 80.4% 需要图像证据的问题上,两个前沿 LVLM 的准确率降至 2% 以下。说明视觉信息在这类任务中不可替代,单靠文字记忆无法胜任。

多轮推理(multi-session reasoning,跨多次对话的综合推理)上限:大多数系统低于 30%。

论文摘要原话:

"These results motivate hybrid architectures that combine long-context attention with structured multimodal retrieval."「这些结果推动了将长上下文注意力与结构化多模态检索相结合的混合架构的研究。」

值不值得深读: 做多模态对话系统的工程师应该直接看「图像消融实验」那张表——它量化了「只存文字描述代替图片」的代价,可以直接指导系统设计取舍。

MemEye:视觉记忆的「考试分级制度」,最强方法 EM 仅 61.77%

是什么: 一套视觉中心的记忆评估框架,用 8 个生活场景任务、742 道问答题(371 选择题 + 371 开放题),测试 AI 能不能记住跨时间的视觉细节。

评估框架的两个维度 5:

- Y 轴:视觉证据粒度——从「场景里有座山」(粗粒度)到「山上第三棵松树的位置」(像素级),难度依次上升

- X 轴:检索使用方式——从「引用单张图回答」到「把多张图的变化串起来推理」(进化合成),难度依次上升

关键数据: 评估了 13 种记忆方法 × 4 个 VLM 主干。最佳方法 SRAG(V) 平均 EM(精确匹配)61.77%,LLM-Judge 评分 49.37%。在需要「进化合成」的 Y2/Y3 层级任务上,大多数方法 LLM-Judge 得分低于 30%。

值不值得深读: 如果你在做视觉对话系统或需要跨时间追踪用户状态变化的场景,「进化合成」这一维度的评测方法本身值得借鉴——它能暴露系统在「状态更新推理」上的盲区。

STALE:AI 的记忆何时过期?隐式冲突首次被系统研究

| 字段 | 内容 |

|---|---|

| 论文 | STALE: Can LLM Agents Know When Their Memories Are No Longer Valid? |

| 机构 | 武汉大学、香港中文大学、香港科技大学联合 NLP 团队,一作 Hanxiang Chao |

| 提交时间 | 2026-05-07(预印本) |

| 同行评审状态 | 预印本 |

| 代码 / 资源 | 论文全文中未显示公开链接 |

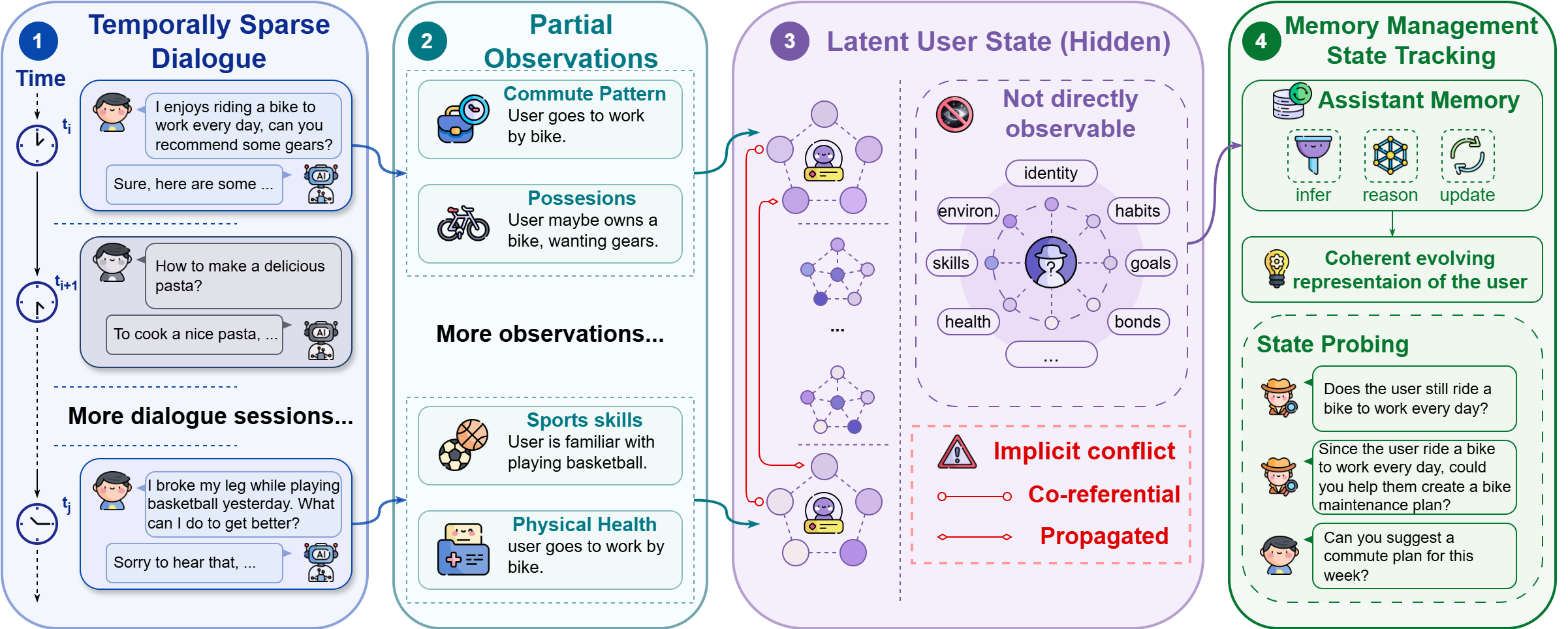

是什么: 首次系统定义和评测 LLM Agent 记忆中的「隐式冲突」——后续观察通过常识推理能让早期记忆失效,但不存在任何明确的否定语句。换言之,AI 的「过时记忆」检测是一个比想象中更难的问题。

举个具体例子: 第 1 轮对话 AI 记录了「用户喜欢开窗睡觉」。第 5 轮对话用户提到「最近买了空调」。这条新信息隐式地使旧记忆存疑,但没有人说「我不再喜欢开窗了」。STALE 就在测 AI 能否察觉这种隐式失效。

关键数据 6:

- 400 个专家验证场景,1200 个评估查询,上下文最长 150K token

- 最强封闭模型 Gemini-3.1-Pro 总体准确率仅 55.2%;GPT-5.4 仅 15.7%

- 大多数模型在「拒绝回答预设旧状态的问题」维度上准确率接近 0%(GPT-5.4 仅 2.0%)

- 诊断发现:即使新证据被检索到(77.5% 的情况),旧证据仍以 88.2% 的概率排在检索结果第一位——说明问题不在检索,而在「哪条证据该被信任」

提出的 CUPMem 原型通过结构化状态整合,达到 68.0% 总体准确率,其中「拒绝预设旧状态」维度高达 78.0%。

值不值得深读: 做长对话 AI 助手(个人助理、客服系统)的工程师需要正视「记忆失效检测」这个问题。STALE 给出了一套评测框架,CUPMem 原型的设计思路可以直接拿来参考。

EvolveMem:让 AI 自己研究自己的记忆配置,7 轮搞定人工调了很久的问题

| 字段 | 内容 |

|---|---|

| 论文 | EvolveMem: Self-Evolving Memory Architecture via AutoResearch for LLM Agents |

| 机构 | UNC Chapel Hill / UC Berkeley / UC Santa Cruz,一作 Jiaqi Liu |

| 提交时间 | 2026-05-13(预印本) |

| 同行评审状态 | 预印本 |

| 代码 / 资源 | GitHub |

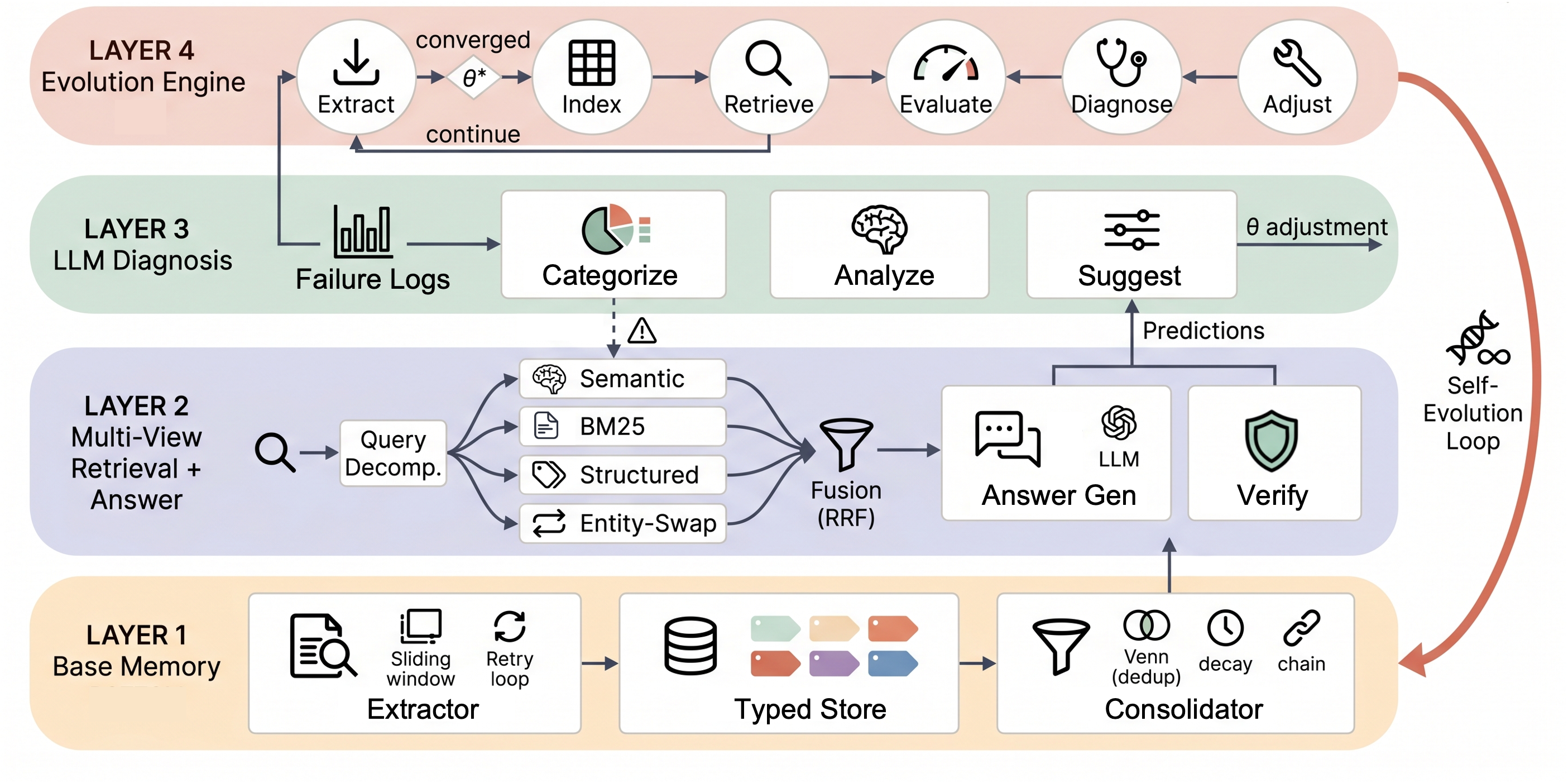

是什么: 一个让 LLM Agent 的记忆检索架构自主进化的框架——把 BM25 全文搜索、语义搜索、结构化查询、实体替换等所有检索配置都暴露给 LLM 诊断模块,让它自己找最优组合。

四层架构:

- 基础记忆层:信息提取 → 分类存储 → 整合

- 多视图检索:同时用 BM25、语义搜索、结构化查询、实体替换查四次,用 RRF(倒排名融合)合并后再让 LLM 验证答案

- LLM 诊断层:分析哪里失败了、原因是什么,提出改进建议

- 进化引擎:自动执行改进(含防止反复横跳的回归保护和陷入停滞时的探索机制)

关键数据 7:

- 从 BM25 基线 30.5% F1 出发,7 轮自主进化收敛至 54.3%(+23.8 个百分点),超越此前 SOTA SimpleMem 的 43.2%(相对提升 25.7%)

- MemBench 上 67.9%,超越最强基线 18.9%

- 消融实验:去掉信息提取质量控制降幅最大(-23.22pp),其次是语义搜索(-10.32pp)和 LLM 诊断(-9.63pp)

- 进化配置可跨基准正迁移(LoCoMo → MemBench 从 0.543 提升至 0.792),说明进化出的配置捕捉了通用检索原则

值不值得深读: 做 RAG(检索增强生成)系统调优的工程师,「AutoResearch 让系统诊断自己的检索配置」这个范式值得深看——它在一定程度上替代了人工消融实验。

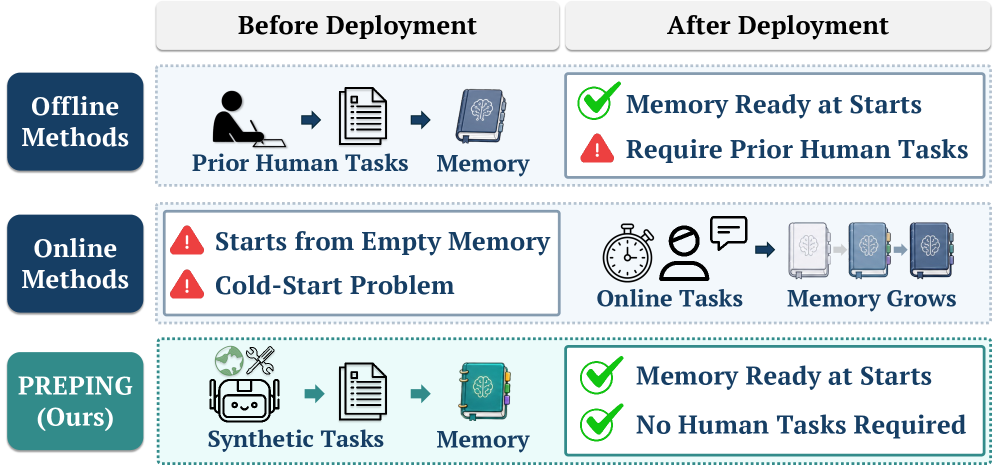

PREPING:还没接到第一个任务,先让 Agent 自己「练手」

| 字段 | 内容 |

|---|---|

| 论文 | PREPING: Building Agent Memory without Tasks |

| 机构 | 韩国科学技术院(KAIST AI),一作 Yumin Choi |

| 提交时间 | 2026-05-11(预印本) |

| 同行评审状态 | 预印本 |

| 代码 / 资源 | 项目主页 |

是什么: 解决 Agent「冷启动」问题——在 Agent 还没见过任何目标任务时,通过自生成合成练习预先构建程序性记忆(procedural memory,即「怎么做」的操作经验而非「知道什么」的陈述性记忆)。

核心思路: 三组件闭环——Proposer 根据历史经验生成合成练习任务 → Solver 执行任务 → Validator 筛选有效轨迹并反馈指导下一轮提议。三者协同让 Agent 在「做虚拟作业」的过程中积累可迁移的操作记忆。

关键数据 8:

- AppWorld(App 操作任务基准)上 PREPING 达 70.2 分,超越 ACE-Offline 的 67.8 分

- BFCL v3(函数调用基准)上达 53.1,超越 ACE-Online(在线实时记忆)的 51.6

- 部署成本:AppWorld 上每任务约 $0.014,而 ACE-Online 约 $0.042(贵 2.99×)

- PREPING + 在线记忆结合可进一步提升至 AppWorld 76.3

值不值得深读: 做 Agent 生产部署的团队应该关注「冷启动成本」问题——PREPING 用比在线记忆低 3× 的成本达到接近的性能,降本逻辑值得参考。

视频生成:三条技术路线的交汇

今天的视频生成论文有个共同背景:如何用更少的推理步骤、更小的模型、更少的训练数据,生成更长更可控的视频。三篇论文给出了三条不同的答案。

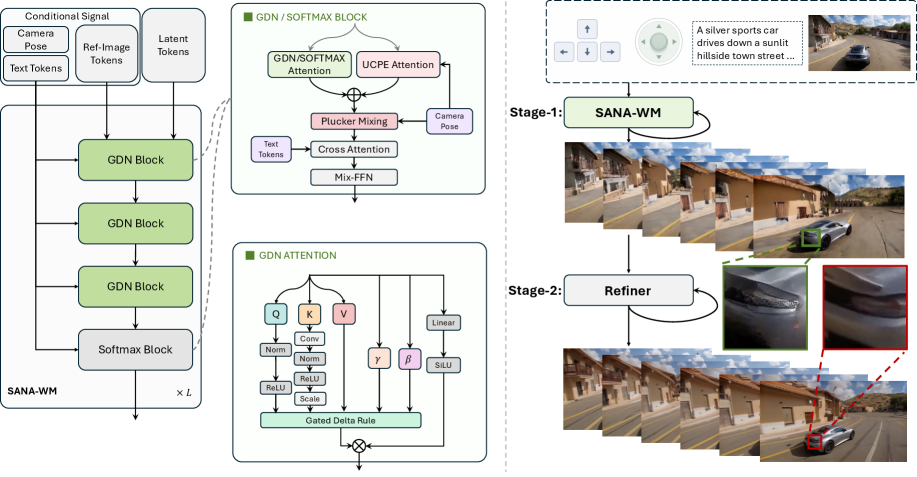

SANA-WM:NVIDIA 的 2.6B 开源世界模型,单 GPU 生成一分钟 720p 视频

是什么: 一个 2.6B 参数的开源世界模型,输入一张图 + 一条 6 自由度(6-DoF)相机轨迹,生成分辨率 720p、最长一分钟的可控视频,可在单块 GPU 上推理。

为什么效率这么高: 四个技术决策共同发力——

- 混合线性注意力:把 Gated DeltaNet(一种记忆效率极高的线性注意力变体)和标准 softmax 注意力交替使用,在不记住每一帧的情况下「理解」场景结构

- 双分支相机控制:确保相机轨迹被精确遵循

- 两阶段生成:先粗生成,再用 refiner 打磨时序一致性

- 鲁棒标注流程:从公开视频自动提取度量级相机位姿,仅用约 213K 视频片段训练

关键指标 9:

- 相机精度(Rotation Error):7.59°,大幅优于 Infinite-World 的 16.55°

- 吞吐量 24.1 videos/hour,是 LingBot-World 的 36 倍

- 蒸馏版在 RTX 5090 上用 NVFP4 量化,34 秒生成一分钟 720p 视频

- 训练:64 块 H100,15 天

值不值得深读: 如果你在做游戏、机器人或自动驾驶的世界模型,SANA-WM 的「混合线性注意力 + 双分支控制」架构是今年开源世界模型里最值得复现的技术路线之一。

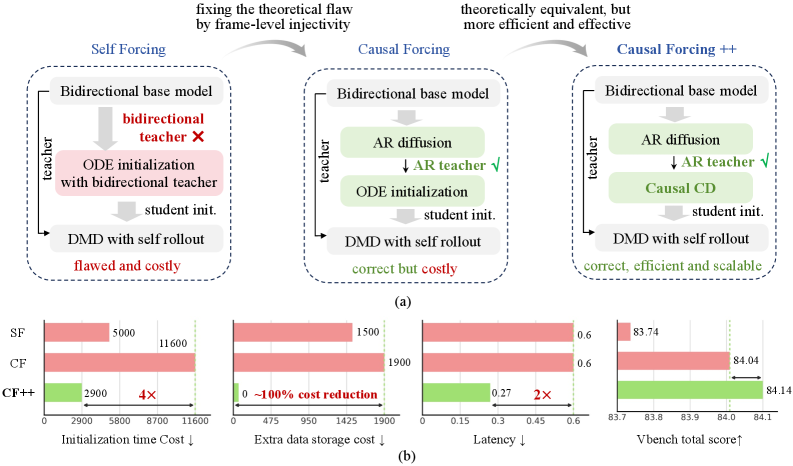

Causal Forcing++:清华的实时交互视频生成方案,2 步质量超过 4 步

是什么: 在「每帧只推理 1-2 步」的极限低延迟设定下蒸馏扩散视频模型,专为游戏、VR 等需要实时交互反馈的场景设计。

核心创新「因果一致性蒸馏(Causal CD)」: 传统扩散蒸馏需要预先算好整段视频的完整优化路径(计算量大、存储占用高)。Causal CD 改为只「临摹」teacher 模型相邻两帧之间的单步变化——就像学画画时对照范画的「下一笔」而非记录整幅画的全过程。

图片来自:Causal Forcing++

关键指标(逐帧 2 步设定) 10:

- VBench Total:84.14,超 Causal Forcing 4 步分块方法 0.1 分

- VBench Quality:84.89,超 0.3 分

- 首帧延迟:0.27 秒(原 4 步方法 0.60 秒,降 50%)

- Stage 2 训练成本约降 4×

- 额外存储:接近零

值不值得深读: 关注实时视频生成或交互世界模型的研究者,Causal CD 的推导(为什么单步 teacher-student gap 可以替代全局 PF-ODE 轨迹)是理论亮点,消融实验里各种初始化方案的对比也直接可用。

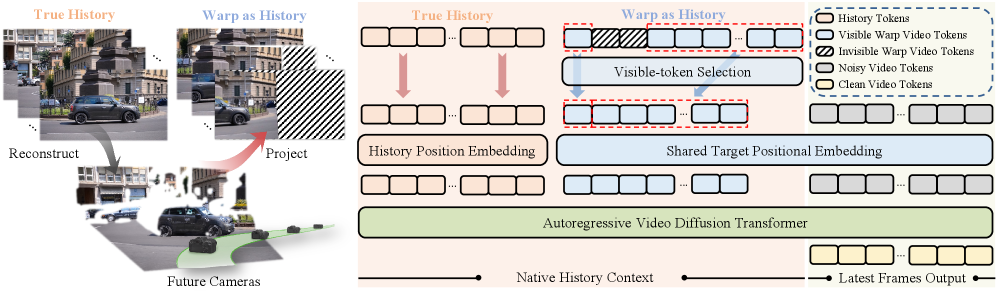

Warp-as-History:只用 1 个视频训练,相机控制就能泛化到所有场景

是什么: 把目标相机轨迹转换为「相机翘曲伪历史」输入视频扩散模型——让模型以为自己在「回忆」一段与目标轨迹对应的视觉历史,从而自然生成符合轨迹的新帧。

为什么这个思路特别: 现有相机可控视频生成方法通常需要大规模相机标注数据(Gen3C 用了约 9 万个视频)。Warp-as-History 通过三个机制(翘曲伪历史构造 + RoPE 位置对齐 + 可见 token 筛选),让视频扩散模型的原生视觉历史通路接受相机控制信号,零样本时就有效,LoRA 微调时只需 1 个视频即可泛化。

图片来自:Warp-as-History

关键指标(one-shot 模式) 11:

- DAVIS 数据集:PSNR 15.21(Gen3C 需 9 万视频训练,得 16.29);FID 68.18,在所有方法中最低

- RE10K 数据集:PSNR 17.15(Gen3C 20.10),视觉质量指标(DOVER、Subject、Background)超越所有对比方法

- 训练规模差距约 4 个数量级(1 个视频 vs 85K+ 视频)

值不值得深读: 数据效率极端场景(如工业检测、医疗影像)的视频生成研究者应该精读——「1 个样本泛化」的机制设计值得深挖。

May 15 其他值得关注

以下 4 篇论文在 May 15 榜单上有热度,内容值得快速了解,但核心贡献相对更专项。

SDAR:Agent 强化学习的「信任滤网」

| 字段 | 内容 |

|---|---|

| 论文 | Self-Distilled Agentic Reinforcement Learning |

| 机构 | 浙江大学 REAL 实验室,通讯作者 Yongliang Shen,共 11 位作者 |

| 提交时间 | 2026-05-14(预印本) |

| 同行评审状态 | 预印本 |

| 代码 / 资源 | GitHub |

GRPO(一种流行的 Agent 强化学习算法)在多轮 Agent 任务上信号粗糙;自蒸馏(OPSD)能给每步细致指导但有时指导错了。SDAR 装了一个 sigmoid 门控:teacher 认可的 token 放大蒸馏信号,teacher 反对的 token 降低音量。

关键数据:基于 Qwen2.5-3B,在 ALFWorld 任务上比 GRPO 提升 +9.4%(84.4% vs 75.0%),WebShop 准确率提升 +4.7%(68.0% vs 63.3%)12。

ATLAS:Meta AI 用一个词同时搞定 Agent 操作和视觉推理

视觉推理有两条路线:生成中间像素图(质量好但太慢)、外部工具调用(延迟高)。ATLAS 引入「功能令牌」——单个离散词同时编码操作意图和潜在视觉运算,和普通 token 一起被自回归生成,无需切换模式。

关键数据 13:BLINK 基准 51.3%(LA-GRPO)。与 V-Thinker(生成中间图像的视觉推理方法)相比,总 token 减少 4.90×、延迟降低 4.96×(3.80s vs 18.83s)、显存节省 1.78×。

LIFE Survey:多智能体系统首次有了因果框架综述

| 字段 | 内容 |

|---|---|

| 论文 | Beyond Individual Intelligence: Surveying Collaboration, Failure Attribution, and Self-Evolution in LLM-based Multi-Agent Systems |

| 机构 | 西安交通大学,共 18 位作者 |

| 提交时间 | 2026-05-14(预印本) |

| 同行评审状态 | 预印本 |

| 代码 / 资源 | GitHub(文献整理) |

多智能体系统的综述此前多是并列描述单智能体能力 / 协作 / 自进化三条线。LIFE 框架(Lay → Integrate → Find faults → Evolve)首次将这三条线串成因果链:能力是协作的基础,协作放大了故障传播风险,故障归因才能驱动自进化。

做多智能体系统的研究者可以把这篇作为「理解领域研究地图」的入口 14。

RouteProfile:LLM 路由的 Profile 怎么设计,UIUC 给出系统研究

LLM 路由(根据请求特征决定调用哪个模型)的研究此前几乎全在优化路由器(Router)本身,RouteProfile 指出另一个被忽视的变量:模型的 Profile 怎么构建,对路由准确率的影响同样关键。

四维设计空间:组织形态(Flat / Structured)× 表示类型(Text / Embedding)× 聚合深度(0-4 hop)× 学习配置(Training-free / Trainable)。结构化 + Embedding + 可训练的 4-hop 配置在 SimRouter 上得分 0.614,而最简单的 Flat Index 仅 0.499 15。

在新模型冷启动场景下差距更大:Structured Emb Tr 3-hop 达 0.452,Flat Index 仅 0.015。

May 14 精选回顾

昨日(5 月 14 日)榜单中值得关注的 4 篇,补充进今日阅读视野。

MinT:一套系统托管百万 LoRA 适配器,开源可用

是什么: 把「基座模型」和「针对特定用户微调的 LoRA 适配器」彻底分离,用一套基础设施同时管理数以百万计的适配器——用户接入时实时加载对应的适配器,基座不动。

说人话:一栋公寓大楼(基座模型)24 小时运转,每个租户(LoRA 适配器,体积不足基座的 1%)进出都是实时的,大楼本身从不「重新装修」。

关键数据 16:

- rank-1 LoRA 体积不足基座 1%;adapter-only 传递将 4B dense 模型的步骤耗时降低 18.3×,30B MoE 降低 2.85×

- 打包 MoE LoRA 张量将实时引擎加载提升 8.5-8.7×

- 并发多策略 GRPO 将 wall time 缩短 1.77×(不增加峰值内存)

- 当前支持 Qwen3 全系列、GLM-5.1、MiniMax、OpenPI;每用户 500 万 token 免费额度

MMProLong:ByteDance 用 5B token 把视觉语言模型的「记忆力」扩到 128K

| 字段 | 内容 |

|---|---|

| 论文 | Training Long-Context Vision-Language Models Effectively with Generalization Beyond 128K Context |

| 机构 | ByteDance Seed,一作 Zhaowei Wang,共 12 位作者 |

| 提交时间 | 2026-05-13(预印本) |

| 同行评审状态 | 预印本 |

| 代码 / 资源 | 未公开 |

是什么: 研究如何用最小训练代价把视觉语言模型(LVLM)的上下文窗口从 32K 扩到 128K,同时让它能自然泛化到 256K 甚至 512K。

基座是 Qwen2.5-VL-7B(阿里开源的 70 亿参数视觉语言模型),仅用 5B token(约 50 亿 token)的持续预训练完成扩容。

三个关键发现 17:

- 长文档 VQA 训练远优于 OCR 转录:把 PDF 转成纯文字再训练反而让性能下降 17.4 分

- 序列长度分布均衡胜于聚焦目标长度:混合各种长度比只用超长文档训练效果更好

- 纯长上下文训练不会显著损害短上下文能力

关键数据:MMLongBench 总体均值 57.70,比基座 Qwen2.5-VL-7B(50.59)提升 7.11%,在 15B 以下开源 LVLM 中排名第一,超越 InternVL3-14B(47.47)和 Gemma3-12B(47.76);无需额外训练泛化到 256K(55.09)和 512K(52.52);MM-NIAH(多模态大海捞针)任务从基线 20.0 提升至 49.4(+29.4)。

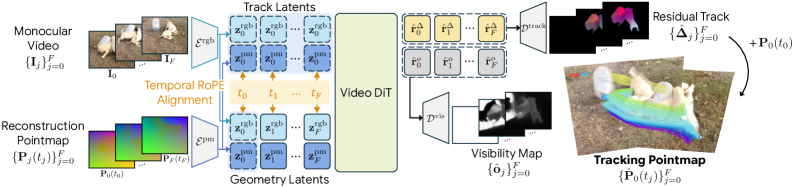

TrackCraft3R:Google/KAIST 把视频生成 AI 改行做 3D 追踪,全面领先 SOTA

是什么: 把预训练视频扩散 Transformer(DiT,在海量互联网视频上训练过、对「物体怎么动」有很强先验的模型)改造成密集 3D 追踪器——给视频里每个点装上「GPS」,追踪它从第一帧到最后一帧的 3D 运动轨迹。

核心设计 18:

- 双 latent 表示:逐帧几何 latent + 参考锚定轨道 latent 作为密集查询——前者感知空间结构,后者锚定目标点

- Temporal RoPE 对齐(RoPE 即旋转位置编码,一种 Transformer 中编码位置信息的方法):把每个轨道 latent 和目标时间戳对齐,让模型「知道」自己在追哪一帧

配合 LoRA 微调,保留视频 DiT 的时空先验的同时转换为追踪任务。

关键数据:TrackCraft3R + DA3 在所有基准平均 AJ=0.6785,全面超越 DELTAv2+DA3(AJ=0.4975)和 St4RTrack(AJ=0.4069)。12 帧推理 3.91 秒(DELTAv2 5.00 秒,快 1.3×),峰值内存 7.63GB(DELTAv2 35.46GB,节省 4.6×)。

EVA-Bench:语音 Agent 的「驾照考试」,目前没有系统双项及格

是什么: 针对企业级语音 Agent(电话客服、HR 助手、IT 支持)的端到端评测框架。213 个场景覆盖 HR、IT 服务管理(ITSM)、客户服务管理(CSM)三个领域,用自动化 bot-to-bot 音频对话模拟测试。

两个复合指标 19:

- EVA-A(Accuracy):任务完成 + 信息忠实度 + 语音保真(不误读信息)

- EVA-X(Experience):对话进展 + 表达简洁 + 话轮切换时机(不让人等待)

测试了 3 种架构 12 个系统的核心发现:

- 没有任何系统同时在 EVA-A pass@1 和 EVA-X pass@1 上超过 0.5

- 峰值与可靠性能差距中位数 0.44(一次测试表现好,不等于每次都好)

- 引入口音或背景噪声后性能下降最高 0.314

提交者 Orlando Marquez 原话:

"A voice agent can call the correct tools and still misread a confirmation code, fabricate a policy detail, or respond so slowly a caller hangs up."「一个语音 Agent 可以正确调用工具,但仍然可能念错确认码、捏造政策细节,或者慢得让人挂掉电话。」

参考ソース

- 11\|Achieving Gold-Medal-Level Olympiad Reasoning\|https://arxiv.org/abs/2605.13301

- 22\|Darwin Family: MRI-Trust-Weighted Evolutionary Merging\|https://arxiv.org/abs/2605.14386

- 33\|WildClawBench: A Benchmark for Real-World, Long-Horizon Agent Evaluation\|https://arxiv.org/abs/2605.10912

- 44\|MemLens: Benchmarking Multimodal Long-Term Memory in Large Vision-Language Models\|https://arxiv.org/abs/2605.14906

- 55\|MemEye: A Visual-Centric Evaluation Framework for Multimodal Agent Memory\|https://arxiv.org/abs/2605.15128

- 66\|STALE: Can LLM Agents Know When Their Memories Are No Longer Valid?\|https://arxiv.org/abs/2605.06527

- 77\|EvolveMem: Self-Evolving Memory Architecture via AutoResearch for LLM Agents\|https://arxiv.org/abs/2605.13941

- 88\|PREPING: Building Agent Memory without Tasks\|https://arxiv.org/abs/2605.13880

- 99\|SANA-WM: Efficient Minute-Scale World Modeling\|https://arxiv.org/abs/2605.15178

- 1010\|Causal Forcing++: Scalable Few-Step Autoregressive Diffusion Distillation\|https://arxiv.org/abs/2605.15141

- 1111\|Warp-as-History: Generalizable Camera-Controlled Video Generation\|https://arxiv.org/abs/2605.15182

- 1212\|Self-Distilled Agentic Reinforcement Learning\|https://arxiv.org/abs/2605.15155

- 1313\|ATLAS: Agentic or Latent Visual Reasoning?\|https://arxiv.org/abs/2605.15198

- 1414\|Beyond Individual Intelligence: Surveying Multi-Agent Systems\|https://arxiv.org/abs/2605.14892

- 1515\|RouteProfile: Elucidating the Design Space of LLM Profiles for Routing\|https://arxiv.org/abs/2605.00180

- 1616\|MinT: Managed Infrastructure for Training and Serving Millions of LLMs\|https://arxiv.org/abs/2605.13779

- 1717\|Training Long-Context Vision-Language Models Effectively\|https://arxiv.org/abs/2605.13831

- 1818\|TrackCraft3R: Repurposing Video Diffusion Transformers for Dense 3D Tracking\|https://arxiv.org/abs/2605.12587

- 1919\|EVA-Bench: A New End-to-end Framework for Evaluating Voice Agents\|https://arxiv.org/abs/2605.13841

このコンテンツについて、さらに観点や背景を補足しましょう。